L’intelligence artificielle a été présentée pendant des années comme la prochaine étape importante dans l’amélioration des résultats pour les patients. Mais les systèmes de santé n’ont pas tout à fait vu cette promesse se concrétiser.

Bien qu’il existe des milliers d’articles de recherche introduisant de nouveaux modèles d’IA potentiels ou validant des produits déjà sur le marché, il y a une pénurie de littérature sur la façon dont les hôpitaux peuvent réellement utiliser ces outils à long terme, et les leaders du système sont principalement laissés pour le comprendre. au coup par coup et espérer le meilleur.

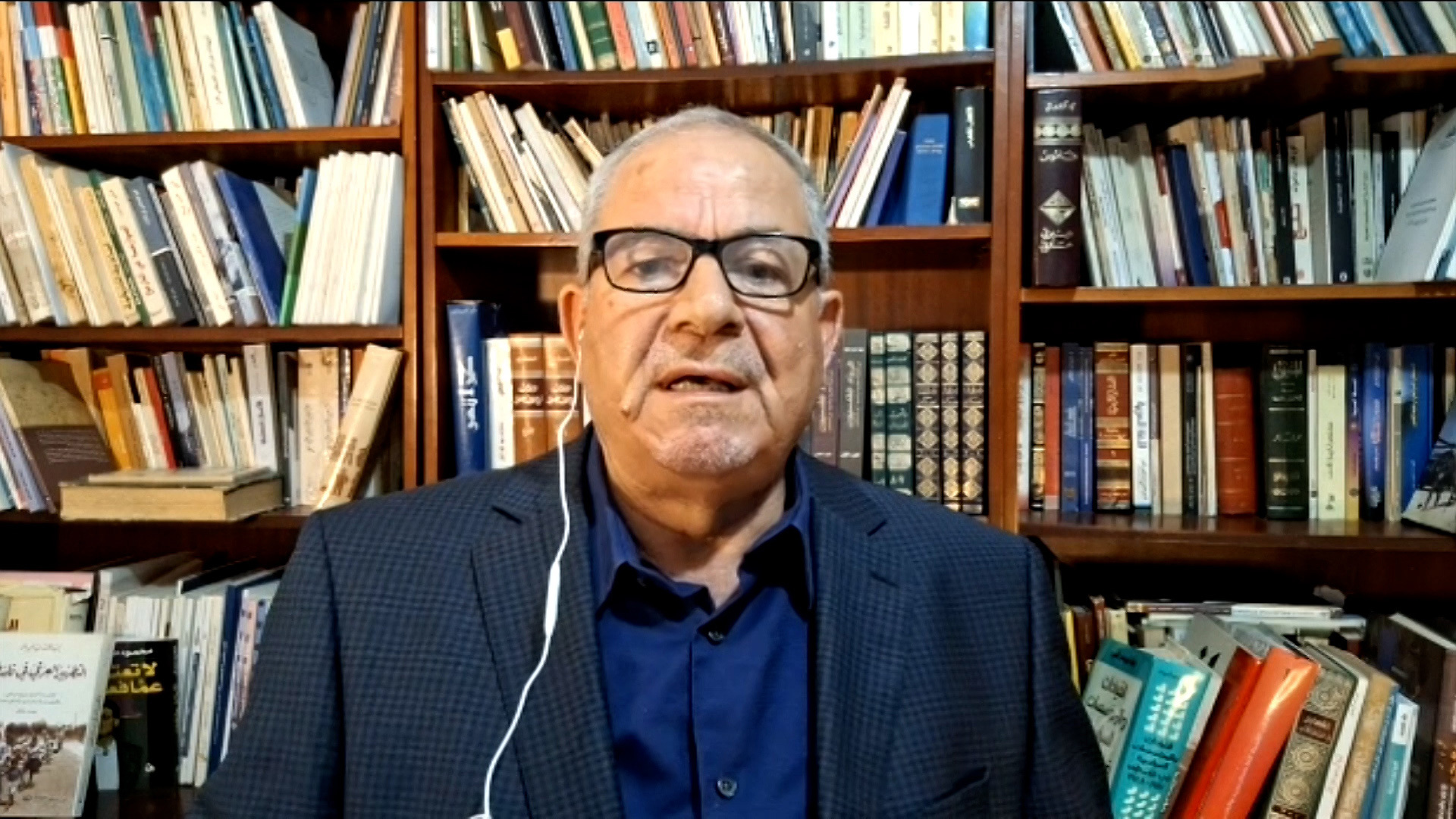

“Il n’y a pas de mode centralisé et coordonné, en termes de contrôle des produits et de leur mise en pratique”, a déclaré le Dr Mark Sendak, responsable de la santé des populations et de la science des données au Duke Institute for Health Innovation. “Chaque système de santé développe sa propre façon de le faire, et notre hypothèse est qu’il y a probablement beaucoup d’apprentissages vraiment précieux à partager.”

L’IA logicielle de tous types comporte des risques de dommages involontaires. Les mécanismes qu’un hôpital met en place pour surveiller l’IA peuvent faire toute la différence en matière de sécurité des patients.

« La question est : « Est-ce que l’algorithme causera par inadvertance des dommages et des biais dans les soins aux patients ? » Parce que s’il manque des patients, cela entraîne un retard dans le diagnostic », a déclaré David Vidal, directeur de la réglementation au Center for Digital Health de la Mayo Clinic.

Vidal, Sendak et un groupe de chercheurs de l’Université du Michigan, de l’Université Duke et d’ailleurs ont lancé un appel aux systèmes de santé pour qu’ils publient des rapports sur leurs expériences de mise en œuvre de l’IA dans les établissements de santé que d’autres peuvent utiliser comme guides de bonnes pratiques. Frontiers, une revue en libre accès, prévoit de publier 10 de ces études de cas l’été prochain.

Mais tandis qu’un hôpital pourrait avoir un grand succès avec les logiciels d’IA, un autre pourrait échouer. Les détails essentiels des populations de patients, la façon dont les cliniciens sont invités à utiliser un outil et la façon dont il est intégré aux processus déterminent en fin de compte à quel point il peut être efficace.

UnityPoint Health, un système multi-états à but non lucratif basé à West Des Moines, Iowa, a rencontré les limites de la technologie lorsqu’il a mis en place un système d’alerte précoce d’IA pour les infections septiques. La chaîne hospitalière a permis aux infirmières de triage d’identifier les cas potentiels de septicémie sans utiliser le logiciel, et les humains ont détecté plus d’infections tôt que l’IA.

“C’était malheureux du point de vue de l’IA, car je pense que l’idée par défaut est que ces modèles vont simplement entrer dans les soins de santé et les révolutionner, et ce n’est tout simplement pas un objectif réalisable pour le moment”, a déclaré Ben Cleveland, principal data scientist d’UnityPoint Health.

Le paysage pour les logiciels de santé, l’IA est massive et la plupart des produits ne passent pas actuellement par le processus d’autorisation de la FDA en tant que dispositifs médicaux. Les vendeurs ont demandé et obtenu l’approbation de la Food and Drug Administration pour seulement une centaine de produits à la fin de 2020.

« Les cabinets et les institutions doivent être en mesure de comprendre le logiciel que nous choisissons et un peu sur la façon dont il a été formé et comment il a été validé, pour leur permettre de comprendre s’ils pensent ou non que cela fonctionnera dans leur pratique avec leur population de patients », a déclaré le Dr Bibb Allen, médecin-chef de l’American College of Radiology Data Science Institute et radiologue diagnostique en pratique communautaire à Birmingham, en Alabama.

À l’avenir, les hôpitaux pourraient établir des comités de gouvernance chargés de choisir les outils d’IA ou de créer des formulaires ou des produits contrôlés avec les compagnies d’assurance, a déclaré Nigam Shah, directeur adjoint de l’information chez Stanford Health Care à Palo Alto, en Californie. « Si l’industrie ne parvient pas à s’autoréglementer, alors 10 ans plus tard, le gouvernement finira par faire claquer son fouet », a-t-il déclaré.

Les éditeurs de logiciels eux-mêmes devraient être responsables de s’assurer que leurs produits sont conçus et utilisés de manière appropriée, a déclaré Suchi Saria, PDG et fondateur de l’éditeur de logiciels Bayesian Health. « Je ne m’attends pas à ce qu’un système de santé devienne soudainement un expert dans la construction de la bonne infrastructure de surveillance », a-t-elle déclaré.

Médecine du Nebraska à Omaha a une équipe en place pour évaluer les outils d’IA, mais le système à but non lucratif repose encore largement sur le bouche à oreille et les expériences rapportées par d’autres systèmes de santé lors du choix des logiciels. Pour chaque nouveau produit, il existe des experts cliniques qui examinent le flux de travail et la gestion des informations pour les unités individuelles. Et il existe encore des obstacles lorsque l’on essaie d’amener les cliniciens à utiliser réellement les informations générées par le logiciel.

“J’espère que cela fait partie de ce que font ce genre d’initiative du Michigan et d’autres – comment nous étendons certains de ces développements et certaines de ces réussites à des endroits plus petits”, a déclaré le Dr Justin Birge, directeur de l’informatique des fournisseurs de Nebraska Medicine. .