TORONTO – Jeunesse, J’écoute dit qu’elle se tourne vers l’intelligence artificielle pour aider à répondre à «l’énorme besoin» alors que de plus en plus de jeunes demandent de l’aide et du soutien en santé mentale.

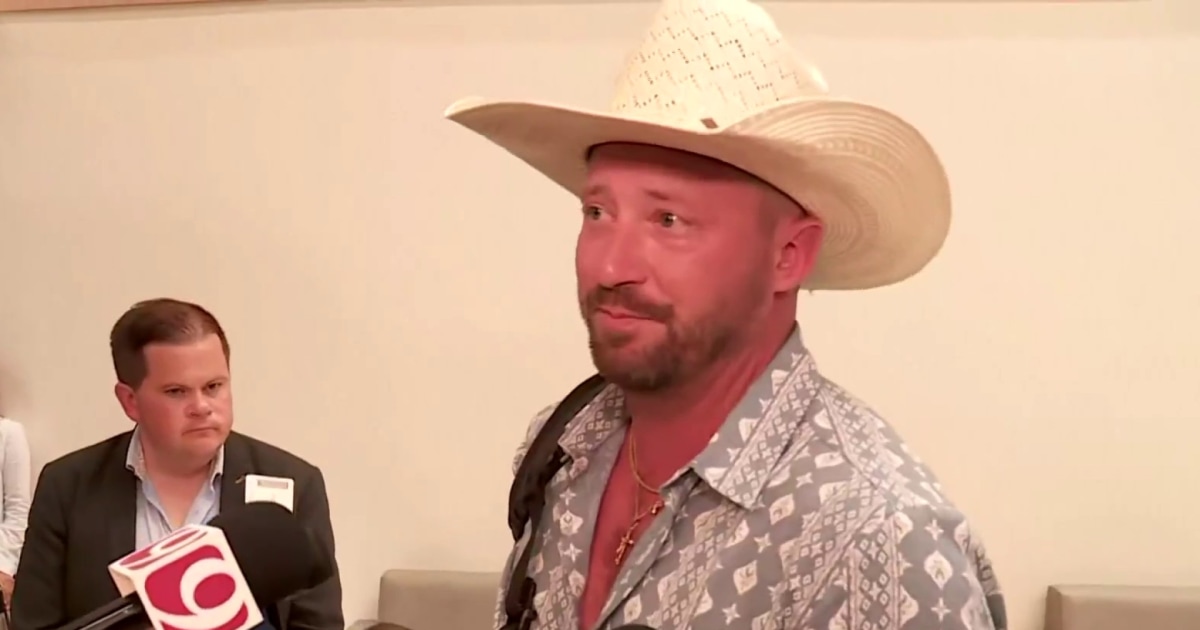

« Les jeunes évoluent rapidement et la technologie évolue plus rapidement », a déclaré Michael Cole, vice-président principal et directeur de l’information de Jeunesse, J’écoute.

La ligne d’assistance s’associe au Vector Institute de Toronto, qui se présente comme un consultant auprès des organisations, des entreprises et des gouvernements pour développer et adopter des programmes d’IA «responsables».

L’IA prévue sera en mesure de reconnaître les mots clés et les modèles de discours des jeunes qui contactent Jeunesse, J’écoute pour aider les conseillers occupés à se concentrer sur ce dont ils ont besoin et à adapter leur soutien en conséquence.

Mais Jeunesse, J’écoute dit être parfaitement conscient que le terme « intelligence artificielle » pourrait alarmer les gens lorsqu’ils évoquent des images d’un ordinateur ou d’un chatbot, plutôt qu’un humain, à l’autre bout de la ligne d’assistance.

Ce n’est pas ainsi que son programme d’IA fonctionnera, a déclaré Katherine Hay, présidente et chef de la direction de l’organisation.

“C’est toujours d’humain à humain”, a déclaré Hay. “Cela ne remplace pas une approche interhumaine.”

Au lieu de cela, les informations recueillies par AI seront disponibles pour les conseillers humains lorsqu’ils travaillent avec le jeune de l’autre côté de l’appel ou de l’échange de SMS, a-t-elle déclaré.

La ligne d’assistance nationale 24 heures sur 24 et 7 jours sur 7 pour les enfants et les adultes a connu une énorme augmentation de la demande pour ses services depuis le début de la pandémie de COVID-19. Après avoir reçu environ 1,9 million d’appels, de textos, de clavardages en direct ou de visites sur son site Web en 2019, Jeunesse, J’écoute a vu ce nombre grimper à plus de 15 millions depuis 2020, selon les chiffres fournis par l’organisation.

L’organisation utilise déjà une technologie d’intelligence artificielle pour faciliter le tri des textes, a déclaré Hay.

Par exemple, si quelqu’un utilise des mots ou des phrases déclencheurs tels que “” Je me sens désespéré, je pense que je veux mourir “, ou quelque chose du genre, cela mettra cette conversation en tête de file (pour parler avec un conseiller) ,” dit-elle.

Roxana Sultan, directrice des données de Vector et vice-présidente de sa division santé, a déclaré que traiter l’IA comme un outil, et non comme un substitut pour les humains, est un élément essentiel de l’utilisation responsable de la technologie dans les soins de santé.

« Nous avons été très clairs avec tous nos partenaires sur le fait que les outils que nous développons sont toujours destinés à être un support pour les cliniciens. Ils ne sont jamais destinés à remplacer le jugement des cliniciens, l’engagement des cliniciens », a déclaré Sultan.

L’outil d’intelligence artificielle de Jeunesse, J’écoute utilisera le “traitement du langage naturel” pour identifier “les mots clés ou les mots déclencheurs qui sont en corrélation avec des types de problèmes spécifiques”, a-t-elle déclaré.

“Si un jeune utilise un mot spécifique dans sa communication qui est corrélé ou lié à un problème ou à une préoccupation spécifique, il sera signalé par ce modèle et il alertera le personnel professionnel”, a déclaré Sultan.

Par exemple, l’IA peut être entraînée à reconnaître les mots qui suggèrent un éventuel trouble de l’alimentation, permettant à un conseiller d’orienter la conversation dans cette direction et d’offrir des ressources et des soutiens spécifiques.

L’IA peut également être formée pour identifier de nouveaux mots et tendances liés à des situations qui causent de la détresse et de l’anxiété, comme une pandémie, le changement climatique, des incendies de forêt ou une fusillade de masse.

“C’est vraiment destiné à augmenter les services que le personnel professionnel fournit”, a déclaré Sultan. “(Cela) les aide à être plus efficients et efficaces dans la façon dont ils gèrent ensuite les problèmes qui surviennent au cours de la conversation.”

La clé, a déclaré Sultan, est de s’assurer que les outils d’IA sont soigneusement testés par des cliniciens avant de les lancer. Jeunesse, J’écoute et Vector prévoient lancer la nouvelle technologie en 2024.

Après son lancement, il est essentiel que le personnel de première ligne qui l’utilise évalue constamment les informations qu’il obtient.

“Vous ne pouvez vraiment pas suivre aveuglément ce qu’un algorithme vous informe de faire dans la pratique. Donc, aussi haute qualité que soit le modèle, aussi bien formé soit-il, il n’est jamais destiné à remplacer votre jugement et votre expérience en tant que clinicien », a déclaré Sultan.

Si l’IA génère quelque chose qui semble “un peu décalé”, cela devrait être signalé et étudié, a-t-elle déclaré.

Une autre préoccupation que les gens peuvent avoir à propos de l’IA est la confidentialité de leurs informations personnelles, a-t-elle déclaré.

“Il est vraiment important d’être clair sur le fait que toutes les données utilisées pour former les modèles sont anonymisées”, a déclaré Sultan.

“Il n’y a donc aucun risque de connaître des informations sur le nom de quelqu’un ou vous savez, tous les facteurs d’identification sont tous supprimés à l’avance.”

L’utilisation de l’IA dans le domaine de la santé mentale est à la hausse dans tout le pays, a déclaré Maureen Abbott, gestionnaire du département d’accès à des services de santé mentale de qualité à la Commission de la santé mentale du Canada.

Ses applications actuelles varient des services individuels à la surveillance des tendances sociales en passant par la croissance des applications de santé mentale, a-t-elle déclaré.

“L’IA est utilisée dans la reconnaissance vocale pour capter une cadence dans la voix d’une personne et aider à diagnostiquer les épisodes maniaques et la dépression”, a déclaré Abbott.

“Il est utilisé dans les chatbots pour l’apprentissage dirigé par la machine et également dans les médias sociaux pour identifier les tendances des idées suicidaires, par exemple, pour rechercher des phrases et des mots.”

Abbott a déclaré qu’il était nécessaire d’élaborer et de mettre en œuvre des normes régissant l’utilisation de l’IA en santé mentale au Canada pour rattraper sa prévalence en augmentation rapide.

“L’IA est déjà utilisée dans notre vie quotidienne, que nous la voyions ou non”, a déclaré Abbott.

“Il est donc naturel que cela se produise également pour la santé mentale et cela se produit rapidement.”

Ce rapport de La Presse canadienne a été publié pour la première fois le 5 juillet 2023.

La couverture santé de la Presse canadienne bénéficie d’un soutien grâce à un partenariat avec l’Association médicale canadienne. CP est seul responsable de ce contenu.

PARTAGER:

REJOINDRE LA CONVERSATION

Tout le monde peut lire Conversations, mais pour contribuer, vous devez être titulaire d’un compte Torstar enregistré. Si vous n’avez pas encore de compte Torstar, vous pouvez en créer un maintenant (c’est gratuit)

S’identifier

Enregistrer

:format(webp)/https://www.thestar.com/content/dam/thestar/life/health_wellness/2023/07/05/kids-help-phone-seeking-help-from-ai-tech-to-meet-demand-for-mental-health-support/20230704170756-64a495d251206826103cf64djpeg.jpg)