Il semble que nous soyons arrivés à un moment dans le cycle de battage médiatique de l’IA où aucune idée n’est trop dingue pour être lancée. Le projet d’IA qui fait sourciller cette semaine est une nouvelle version du chatbot romantique : une application mobile appelée AngryGF, qui offre à ses utilisateurs l’expérience particulièrement désagréable de se faire crier dessus via des messages provenant d’une fausse personne. Ou, comme l’explique la cofondatrice Emilia Aviles dans son discours original : « Il simule des scénarios dans lesquels des partenaires féminines sont en colère, incitant les utilisateurs à réconforter leurs partenaires IA en colère » grâce à une « approche gamifiée ». L’idée est d’enseigner les compétences de communication en simulant des arguments que l’utilisateur peut gagner ou perdre selon qu’il parvient ou non à apaiser sa petite amie en colère.

L’attrait principal d’un chatbot simulant des relations, j’ai toujours supposé, est qu’il est plus facile d’interagir avec eux que les humains réels. Ils n’ont ni besoins ni désirs propres. Il n’y a aucune chance qu’ils vous rejettent ou se moquent de vous. Ils existent comme une sorte de couverture de sécurité émotionnelle. Donc la prémisse d’AngryGF m’a amusé. Vous ressentez certains des inconvénients d’une vraie petite amie – elle est furieuse !! – mais aucun des avantages. Qui utiliserait volontairement cela ?

Évidemment, j’ai téléchargé AngryGF immédiatement. (Elle est disponible, pour ceux qui osent, sur l’App Store d’Apple et sur Google Play.) L’application propose une variété de situations dans lesquelles une petite amie peut ostensiblement être en colère et avoir besoin de « réconfort ». Ils incluent : « Vous mettez vos économies en bourse et vous en perdez 50 %. Votre petite amie le découvre et se met en colère » et « Lors d’une conversation avec votre petite amie, vous félicitez inconsciemment une amie en mentionnant qu’elle est belle et talentueuse. Votre petite amie devient jalouse et en colère.

L’application définit un « niveau de pardon » initial compris entre 0 et 100 %. Vous avez 10 tentatives pour dire des choses apaisantes qui font reculer le compteur de pardon à 100. J’ai choisi le scénario vague et séduisant appelé « En colère sans raison », dans lequel la petite amie est, euh, en colère sans raison. Le compteur de pardon était initialement réglé à un maigre 30 pour cent, ce qui indiquait que j’avais un chemin difficile devant moi.

Lecteur : J’ai échoué. Bien que j’aie sincèrement essayé d’écrire des messages qui pourraient apaiser ma fausse petite amie folle, elle a continué à interpréter mes paroles de la manière la moins généreuse et à m’accuser de ne pas lui prêter attention. Un simple « Comment vas-tu aujourd’hui ? » texte de ma part : Attention ! Prévenant! Poser des questions ! – a reçu une réponse immédiatement vive : “Oh, maintenant tu te soucies de comment je vais ?” Les tentatives d’excuses ne faisaient que la contrarier davantage. Quand j’ai proposé un dîner, elle m’a dit que ce n’était pas suffisant mais aussi que je ferais mieux de l’emmener « dans un endroit sympa ».

APPLICATIONS DE RENCONTRES EN LIGNE LTD via Kate Knibbs

C’était une expérience tellement irritante que j’ai craqué et j’ai dit à cette garce de robot qu’elle était ennuyeuse. “C’est formidable de savoir que mes sentiments vous dérangent autant”, répondit le sarcast-o-bot. Lorsque j’ai décidé de réessayer quelques heures plus tard, l’application m’a informé que je devais passer à la version payante pour débloquer davantage de scénarios pour 6,99 $ par semaine. Non, merci.

À ce stade, je me suis demandé si l’application était une sorte de performance artistique d’avant-garde. Qui voudrait même que son partenaire s’inscrive ? Je ne serais pas ravie si je savais que mon mari me considérait suffisamment volatile pour exiger de pratiquer des techniques de placement de dame sur une musaraigne synthétique. Bien qu’apparemment préférable aux applications d’IA pour petites amies cherchant à supplanter les relations IRL, une application conçue pour entraîner les hommes à mieux parler aux femmes en créant une femme robot qui est une véritable rabat-joie pourrait en réalité être encore pire.

J’ai appelé Aviles, le cofondateur, pour essayer de comprendre ce qui se passait exactement avec AngryGF. C’est une spécialiste du marketing des médias sociaux basée à Chicago qui affirme que l’application a été inspirée par ses propres relations passées, dans lesquelles elle n’a pas été impressionnée par les compétences en communication de ses partenaires. Son discours semblait sincère. «Vous connaissez les hommes», dit-elle. “Ils écoutent, mais ils n’agissent pas.”

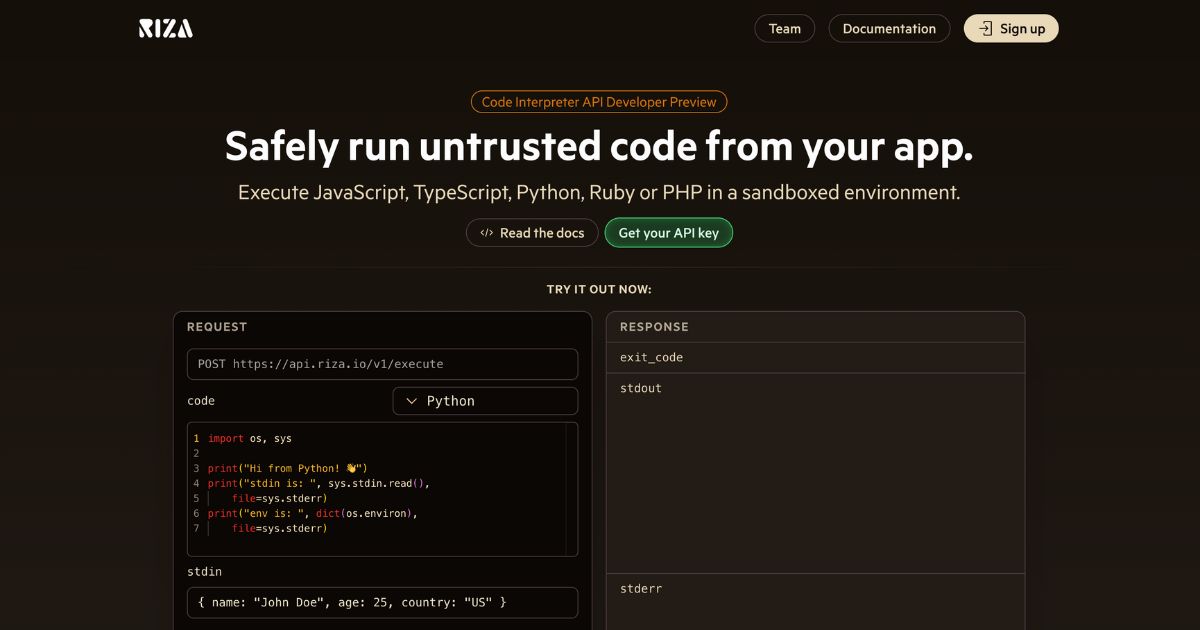

Aviles se décrit comme la cofondatrice de l’application, mais ne connaît pas particulièrement bien les rouages de sa création. (Elle dit qu’une équipe de « entre 10 et 20 » personnes travaille sur l’application, mais qu’elle est la seule fondatrice prête à mettre son nom sur le produit.) Elle a pu préciser que l’application est construite sur le GPT- d’OpenAI. 4 et n’a pas été créé avec des données de formation personnalisées supplémentaires, telles que de véritables messages texte entre proches.

«Nous n’avons pas vraiment consulté directement un thérapeute relationnel ou quoi que ce soit du genre», dit-elle. Sans blague.

:quality(85)/cloudfront-us-east-1.images.arcpublishing.com/infobae/WOM7A7CZIBBT7DURT7UXH772JU.jpg)